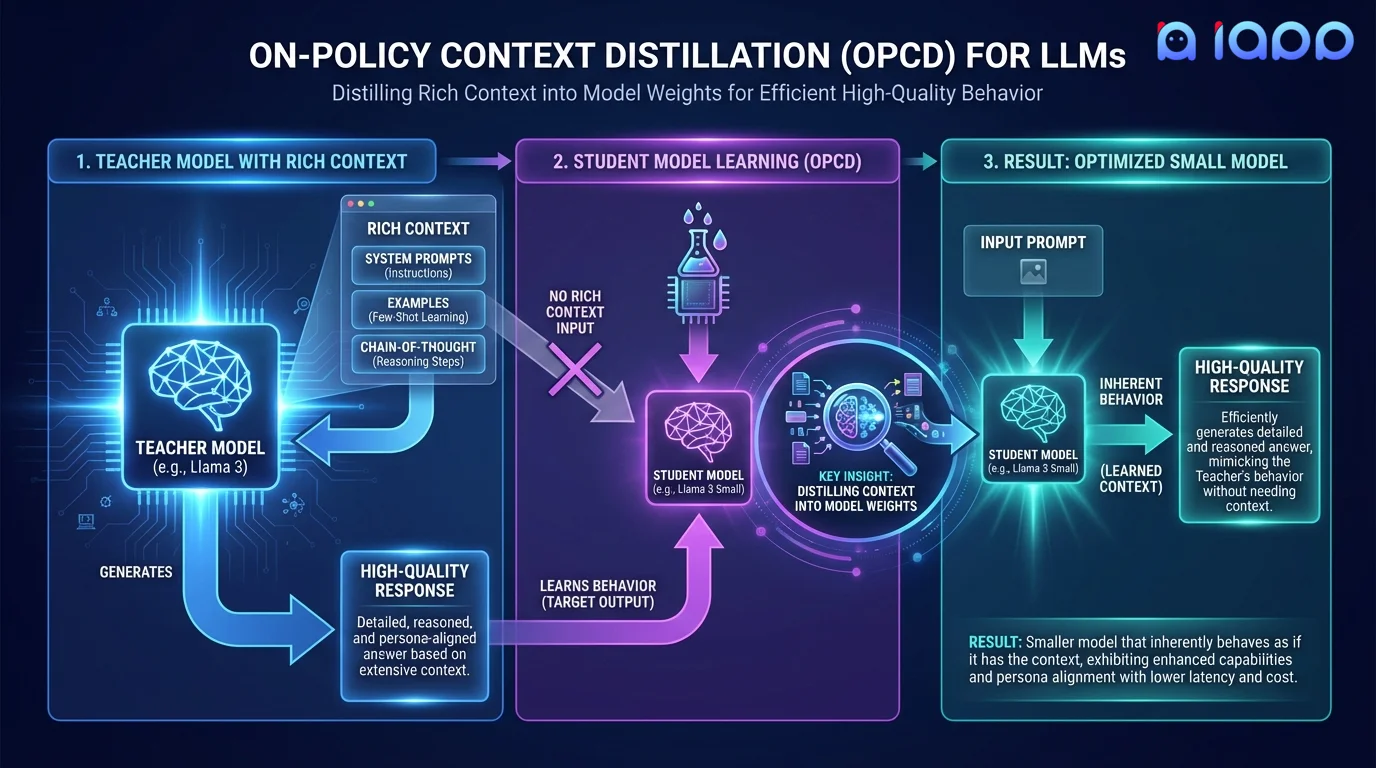

On-Policy Context Distillation (OPCD)

กลั่นกรอง System Prompt ที่ซับซ้อน ตัวอย่าง Few-shot และกระบวนการคิดแบบ Chain-of-Thought ลงไปในน้ำหนักของโมเดลโดยตรง โมเดลของคุณจะเรียนรู้ที่จะทำงานเสมือนมี Context ที่สมบูรณ์แบบอยู่เสมอ

เริ่มต้นใช้งาน

Context Distillation คืออะไร?

Context Distillation คือกระบวนการฝึกโมเดลให้ซึมซับพฤติกรรมที่เกิดจาก Context เฉพาะ (System Prompt, ตัวอย่าง Few-shot หรือคำสั่ง Chain-of-Thought) เพื่อให้โมเดลสามารถสร้างผลลัพธ์คุณภาพสูงได้โดยไม่ต้องใช้ Context นั้นในขั้นตอน Inference

On-Policy Context Distillation (OPCD) ยกระดับขึ้นไปอีกด้วยการใช้ผลลัพธ์ที่โมเดลสร้างขึ้นเอง (On-Policy) แทนชุดข้อมูลแบบคงที่ โมเดลจะสร้างคำตอบโดยใช้ Context ที่สมบูรณ์ จากนั้นเรียนรู้ที่จะสร้างคำตอบเดียวกันโดยไม่ต้องใช้ Context วิธีนี้มีประสิทธิภาพมากกว่าเพราะข้อมูลฝึกสอดคล้องกับการกระจายผลลัพธ์จริงของโมเดล

ผลลัพธ์ที่ได้: Inference เร็วขึ้น (ไม่ต้องใช้ System Prompt ยาวๆ) ค่าใช้จ่ายโทเค็นลดลง พฤติกรรมสม่ำเสมอมากขึ้น และสามารถฝังรูปแบบการให้เหตุผลที่ซับซ้อนลงในตัวโมเดลได้โดยตรง

วิธีการทำงาน

จากพฤติกรรมที่ต้องพึ่ง Context สู่พฤติกรรมที่ไม่ต้องใช้ Context

ออกแบบ Context

กำหนด System Prompt ตัวอย่าง และคำสั่งที่ทำให้โมเดลแสดงพฤติกรรมตามที่ต้องการ

สร้างข้อมูลแบบ On-Policy

โมเดลสร้างคำตอบคุณภาพสูงโดยใช้ Context เต็มรูปแบบบน Prompt ที่หลากหลาย

ฝึก Distillation

ฝึกโมเดลให้สร้างคำตอบเดียวกันโดยไม่ต้องใช้ Context

ตรวจสอบความถูกต้อง

ยืนยันว่าโมเดลที่ไม่ต้องใช้ Context มีคุณภาพและพฤติกรรมเทียบเท่ากับโมเดลที่ต้องใช้ Context

ข้อดีหลัก

Inference เร็วขึ้น

กำจัด System Prompt ยาวๆ และตัวอย่าง Few-shot ออกจากทุกคำขอ ลดโทเค็นอินพุตได้ 50-90% ลดเวลาตอบสนองและต้นทุนได้อย่างมาก

ค่าใช้จ่ายโทเค็นลดลง

ไม่ต้องจ่ายค่าโทเค็น System Prompt หลายพันโทเค็นในทุกการเรียก API อีกต่อไป พฤติกรรมถูกฝังอยู่ในตัวโมเดลแล้ว

พฤติกรรมสม่ำเสมอ

โมเดลทำงานตามที่ต้องการเสมอ ไม่ว่า Prompt จะถูกจัดรูปแบบอย่างไร ไม่มีปัญหาความอ่อนไหวต่อ Prompt อีกต่อไป

ปกป้องทรัพย์สินทางปัญญา

System Prompt ที่คุณสร้างขึ้นอย่างพิถีพิถันจะถูกฝังอยู่ในน้ำหนักโมเดล ไม่ถูกเปิดเผยใน API ปกป้อง Prompt Engineering ของคุณ

กรณีการใช้งาน

เหมาะสำหรับการใช้งานจริงที่มีปริมาณสูง

กำจัด System Prompt

ไม่ต้องใช้ System Prompt ยาวๆ ที่กำหนดบุคลิก กฎพฤติกรรม และรูปแบบคำตอบ ฝังทุกอย่างลงในโมเดลโดยตรง

ซึมซับตัวอย่าง Few-Shot

ไม่ต้องส่งตัวอย่าง 5-10 รายการในทุกคำขออีกต่อไป โมเดลเรียนรู้รูปแบบครั้งเดียวและนำไปใช้กับอินพุตในอนาคตทั้งหมด

ฝัง Chain-of-Thought

กลั่นกรองรูปแบบการให้เหตุผลที่ซับซ้อนลงในโมเดล เพื่อให้โมเดลคิดทีละขั้นตอนโดยไม่ต้องใช้ CoT Prompting

ซึมซับพฤติกรรมความปลอดภัย

ฝั��งแนวทางความปลอดภัยและนโยบายเนื้อหาลงในพฤติกรรมของโมเดลโดยตรง ทำให้แข็งแกร่งกว่าการใช้ Prompt-based Guardrails

เข้ารหัสเสียงของแบรนด์

กลั่นกรองโทนเสียง บุคลิกภาพ และสไตล์การสื่อสารของแบรนด์ลงในโมเดล เพื่อให้ทุกคำตอบตรงกับแบรนด์โดยไม่ต้องใช้ Style Prompt

ทำให้รูปแบบผลลัพธ์เป็นมาตรฐาน

สอนโมเดลให้สร้างผลลัพธ์ที่มีโครงสร้าง (JSON ตาราง เทมเพลตเฉพาะ) อย่างสม่ำเสมอ โดยไม่ต้องใส่คำสั่งรูปแบบในทุกคำขอ

ทำไมต้องเลือก iApp Technology?

บริษัท AI ชั้นนำของประเทศไทยที่มีความเชี่ยวชาญด้าน LLM ที่พิสูจน์แล้ว

โครงสร้างพื้นฐานระดับโลก

เราดำเนินการซูเปอร์คอมพิวเตอร์ NVIDIA H100, B200 และ GB200 OPCD ต้องการสร้างข้อมูล On-Policy จำนวนมาก และโครงสร้างพื้นฐานของเราสามารถรองรับได้ในระดับใหญ่

ผลงานที่พิสูจน์แล้ว

เราเป็นผู้สร้าง LLM สำหรับใช้งานจริงที่ได้รับความไว้วางใจจากองค์กรทั่วประเทศไทยและเอเชียตะวันออกเฉียงใต้

ราคา

ราคาตามโปรเจกต์

ราคา Context Distillation ขึ้นอยู่กับความซับซ้อนของ Context ที่ต้องการกลั่นกรอง ขนาดโมเดล และปริมาณข้อมูล On-Policy ที่ต้องการ

- ✓ ให้คำปรึกษาเบื้องต้นและวิเคราะห์ Context ฟรี

- ✓ ราคาโปร่งใสไม่มีค่าใช้จ่ายแอบแฝง

- ✓ รับประกันคุณภาพเทียบเท่�าเกณฑ์มาตรฐานที่ต้องใช้ Context

- ✓ รวมบริการสนับสนุนหลังส่งมอบ